大模型微调方法总结

参考链接:https://blog.csdn.net/v_JULY_v/article/details/132116949

前言:随着chatGPT的备受欢迎,大模型异常火爆,各大厂商相继推出自己的大模型。

二级公司和用户需要根据自身的垂直领域微调这些具有语义理解能力的大模型,以满足特定领域的业务需求,如医疗,法律咨询等。

但是当微调这一类比较大的模型时,更新所有参数不太可行。以 GPT-3 175B 为例——部署微调模型的独的成本极其昂贵。

huggingface上的框架。 如 1 指令微调 huggingface有PEFT 2 强化学习的human feedback , huggingface有TRL框架

1 1 中 有6种方法, LORA, p-tuning-V1, p-tuning-V2等

2 TRL框架

详细使用方法待后续补充

一 LoRA:

1 低(秩)rank 自适应微调方法

2 背景及本质

大模型的参数更新耗费大量现存为此, 微软的研究者们于2021年通过论文《LORA: LOW-RANK ADAPTATION OF LARGE LANGUAGE MODELS》提出了低秩适应LoRA

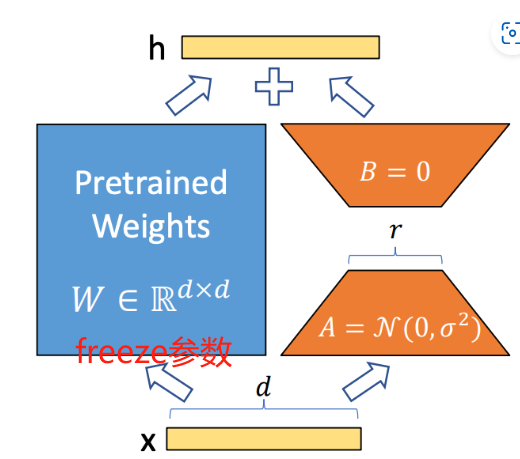

- 它冻结了预训练的模型权重,并将可训练的秩分解矩阵注入到 Transformer 架构的每一层中,大大减少了下游任务的可训练参数的数量

We propose Low-Rank Adaptation, or LoRA, which freezes the pre-trained model weights and injects trainable rank decomposition matrices into each layer of the Transformer architecture, greatly reducing the number of trainable parameters for downstream tasks.

- 与使用 Adam 微调的 GPT-3 175B 相比,LoRA 可以将可训练参数数量减少 10,000 倍,GPU 内存需求减少 3 倍

Compared to GPT-3 175B fine-tuned with Adam, LoRA can reduce the number of trainable parameters by 10,000 times and the GPU memory requirement by 3 times.

3 大致操作总览

1 正向推理 的所有参数 结果

2 反向梯度的所有结果

3 反向梯度更新的计算, sGD不带状态的会相对省内存,但是adam 就会记录过往若干梯度参数。

训练:

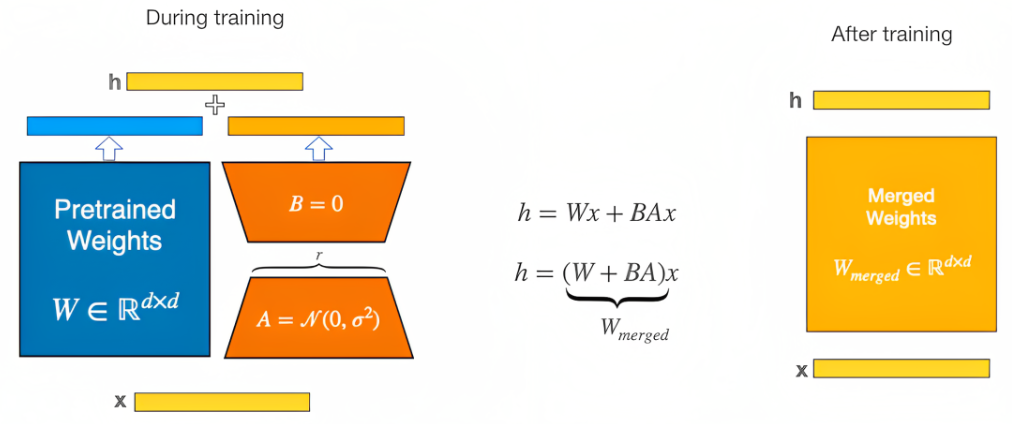

图 W0+Lora层结果

lora=w1 正态分布+w2 全0

推理:lora层需要merge会W0,即w1*w2+w0即可。

4 实际操作

4.1 微软DeepSpeed-Chat中对LoRA微调的实现

# TODO 待补充--->>>>>>

代码中体现

F.linear(input, self.weight, self.bias) + (self.lora_dropout(input)

@ self.lora_right_weight @ self.lora_left_weight) * self.lora_scaling

加号左侧为原结构支路,加号右侧为新增支路,self.lora_right_weight 和self.lora_left_weight 分别为两个新引入线性层的参数.

4.2 Huggingface上PEFT库对LoRA

更详细使用方法

# TODO 待补充--->>>>>>

5 另外应用

lora层可针对某一层参数,可插拔

对stable diffusion 也可用。

二 QLora微调方法

2.1 前言

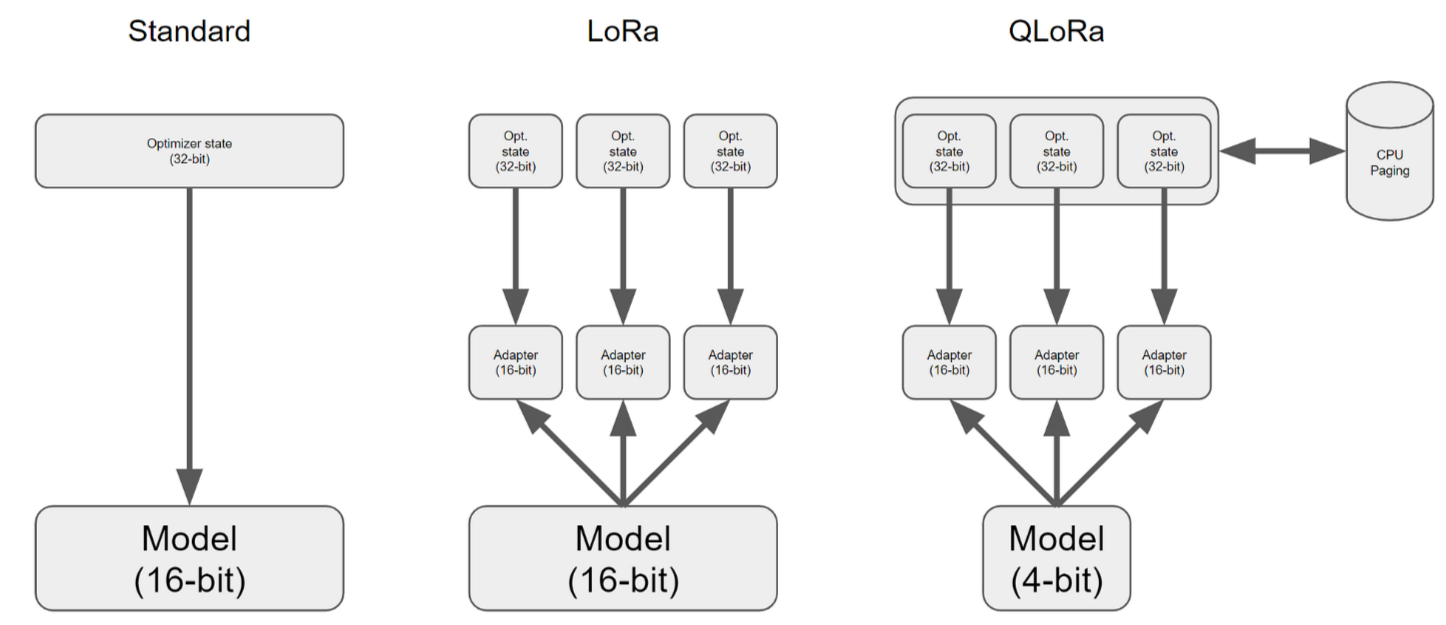

QLoRA于今23年5月份通过此篇论文《QLORA: Efficient Finetuning of Quantized LLMs》被提出,本质是对LoRA的改进,相比LoRA进一步降低显存消耗。

- 因为LoRa为LLM的每一层添加了少量的可训练参数(适配器),并冻结了所有原始参数。这样对于微调,只需要更新适配器权重,这可以显著减少内存占用

- 而QLoRa更进一步,引入了4位量化、双量化和利用nVidia统一内存进行分页。

所有这些对比Lora,进一步降低了显存消耗。

下图总结了不同的微调方法及其内存需求,其中的QLoRA通过将模型量化到4位精度并使用分页优化器管理内存峰值来改进LoRA.

2.2 模型量化

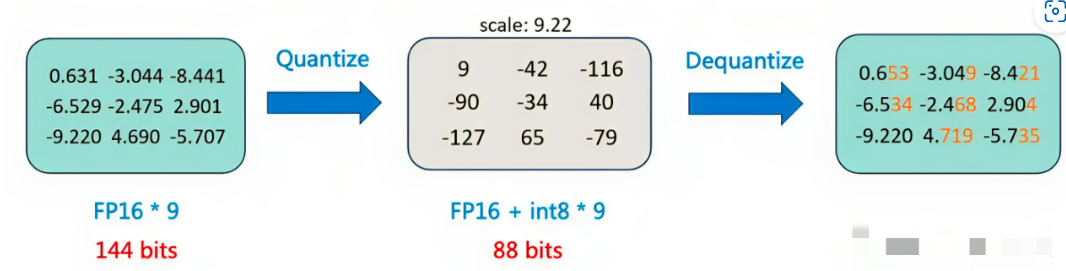

原理:将浮点数值转化为定点数值,同时尽可能减少计算精度损失的方法。

这样就减小了模型, 在计算时,最后再将定点数据反量化为浮点数据得到最终的结果。

综合而言,我们可以对模型参数(weight)、激活值(activation)或者梯度(gradient)做量化。通常而言,模型的参数分布较为稳定,因此对参数 weight 做量化较为容易(比如,QLoRA便是对weight做量化)

至于模型的激活值往往存在异常值,直接对其做量化,会降低有效的量化格点数,导致精度损失严重,因此,激活值的量化需要更复杂的处理方法(如SmoothQuant)

更多内容详见: 《zhouyi量化白皮书》

三 P-tuning V1/V2

3.1 P-Tuning V1:将自然语言的离散模版转化为可训练的隐式prompt (连续参数优化问题)

3.2 P-Tuning V2:在输入前面的每层加入可微调的参数

-----------------------对于NPU

总结各种微调

微调后的模型 在SDK的使用

背景

各个厂商的差异化场景落地势必会基于大模型的微调,

微调后的模型可能产生zhouyi 的sdk 不适配情况。

总结了主流的微调方法。以及后续会对sdk适配这些微调模型进行验证。

参考链接: